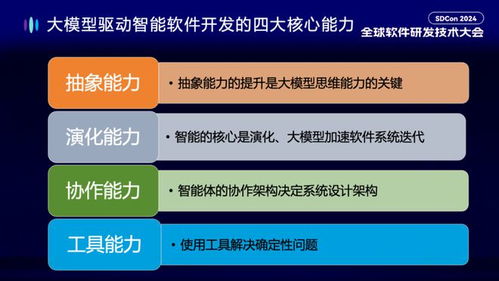

大模型驱动软件开发的误区和思考

随着人工智能技术的快速发展,大模型在软件开发领域逐渐发挥重要作用。在实际应用中,开发者和管理者往往容易陷入一些误区,可能影响软件的质量和开发效率。本文探讨大模型驱动软件开发中的常见误区,并提出相应的思考。

一、常见误区

1. 依赖过度,忽视传统开发流程

一些团队错误地认为大模型能完全替代人工设计、编码和测试。例如,依赖模型自动生成代码,却忽略了对代码逻辑、安全性和性能的审查,导致软件缺陷频发。过度依赖模型还可能导致团队技能退化,失去对核心业务逻辑的掌控。

2. 数据质量与偏见问题

大模型的输出高度依赖训练数据。如果数据存在偏差或不完整,模型可能生成有缺陷的代码或建议,进而引入软件漏洞。例如,基于有偏见的开源代码训练模型,可能复制安全漏洞或低效模式。

3. 成本与资源高估

大模型的部署和维护需要大量计算资源和专业人才,一些团队可能低估了这些成本。短期内投入过高,却未获得预期收益,导致项目超支或延期。

4. 忽视伦理与安全风险

大模型可能生成包含敏感信息或不符合法规的代码,如涉及隐私泄露或版权问题。模型本身的安全漏洞可能被恶意利用,影响软件的整体安全性。

5. 期望不切实际

部分开发者期望大模型能“一键”解决所有开发问题,忽略了软件开发是一个迭代、协作的过程。这种期望可能导致团队忽视需求分析、测试和用户反馈等关键环节。

二、思考与建议

1. 平衡自动化与人工干预

大模型应被视为辅助工具,而非替代品。开发团队需结合传统方法,例如在代码生成后引入人工审查、单元测试和集成测试,确保软件质量。同时,持续培训团队,提升对大模型的理解和应用能力。

2. 注重数据治理与多样性

在训练或使用大模型时,应优先选择高质量、多样化的数据集,并进行定期评估和清理。通过数据增强和偏见检测,减少模型输出中的错误和偏差。

3. 合理规划资源与成本

在引入大模型前,团队需评估实际需求,制定分阶段实施计划。优先在小规模项目中试点,验证效果后再扩大应用。同时,探索开源工具和云服务,以优化成本。

4. 强化伦理与安全措施

建立代码审查机制,检查模型输出是否符合伦理和法规要求。实施安全扫描工具,识别潜在漏洞。团队应关注模型透明度,确保可解释性,便于追踪问题源头。

5. 设定合理期望,强调协作

明确大模型在开发中的定位,例如用于快速原型生成、代码优化或文档辅助。鼓励团队保持批判性思维,结合用户反馈持续迭代。通过敏捷开发方法,将模型工具融入协作流程。

结语

大模型为软件开发带来了创新机遇,但也伴随挑战。只有认清误区,采取务实策略,才能充分发挥其潜力,推动软件行业向更高效、智能的方向发展。未来,随着技术成熟,大模型有望成为开发者的得力助手,但始终离不开人类的智慧和监督。

如若转载,请注明出处:http://www.ywzc53.com/product/1.html

更新时间:2026-02-24 12:57:24